深度學(xué)習(xí)與神經(jīng)形態(tài)計(jì)算之爭(zhēng) 英特爾高管與AI大牛互懟

英特爾神經(jīng)形態(tài)計(jì)算實(shí)驗(yàn)室主任Mike Davies在國際固態(tài)電路會(huì)議(ISSCC)上將深度學(xué)習(xí)批判了一番。

Davies說,深度學(xué)習(xí)跟大多數(shù)人印象中的并不一樣,它只是一種優(yōu)化程序,實(shí)際上并不是真正在“學(xué)習(xí)”。

受到攻擊的重災(zāi)區(qū),還是深度學(xué)習(xí)中的反向傳播算法。

他說,反向傳播與大腦無關(guān),而只是在深度學(xué)習(xí)計(jì)算機(jī)程序中用來優(yōu)化人工神經(jīng)元響應(yīng)的一種數(shù)學(xué)技術(shù)。

自然的反向傳播例子,并不存在。

雖然他承認(rèn)深度學(xué)習(xí)現(xiàn)在非常有效,但他也堅(jiān)定地強(qiáng)調(diào)里,大腦才是真正智能計(jì)算的范例。

Davies死死抓住不放的“不像大腦”這個(gè)問題,也正是深度學(xué)習(xí)教父Hinton一直重視的。

不過對(duì)于這次批判本身,美國媒體ZDNet認(rèn)為,他主要的攻擊目標(biāo)其實(shí)是Yann LeCun。

深度學(xué)習(xí)vs.神經(jīng)形態(tài)計(jì)算之爭(zhēng)

為何攻擊LeCun?

就在周一,這位AI大牛在同一個(gè)學(xué)術(shù)會(huì)議上發(fā)言時(shí),順便批判了Davies在搞的神經(jīng)形態(tài)計(jì)算。

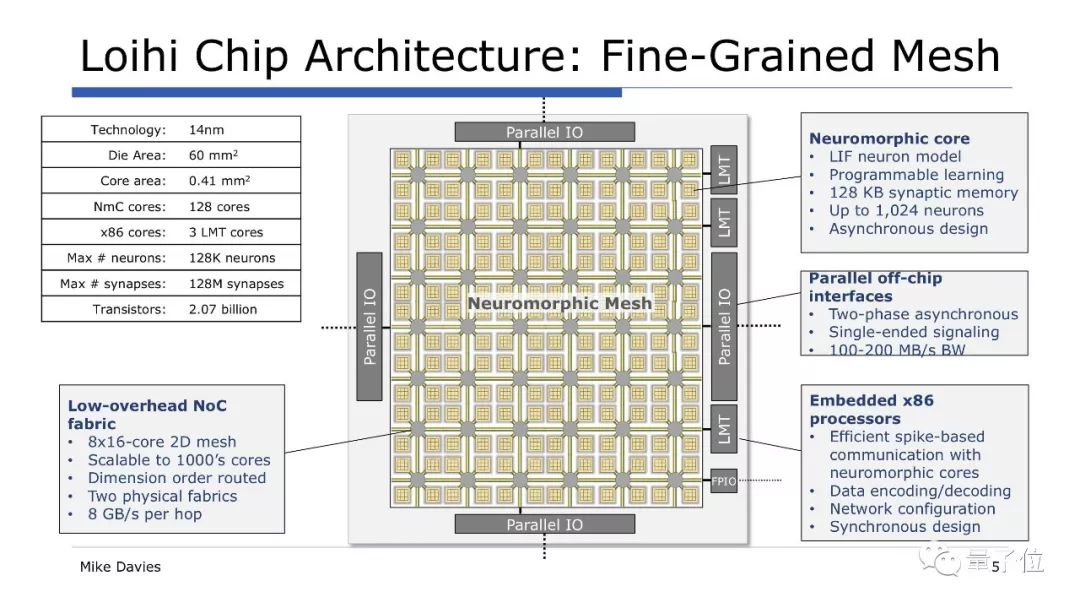

神經(jīng)形態(tài)計(jì)算是英特爾布局的一個(gè)重要新興方向,在這個(gè)領(lǐng)域,他們推出了芯片樣品Loihi。英特爾說,這種芯片可以實(shí)現(xiàn)自主學(xué)習(xí),而且能耗只有傳統(tǒng)芯片的千分之一。

而Davies就是神經(jīng)形態(tài)計(jì)算實(shí)驗(yàn)室的負(fù)責(zé)人,主管著英特爾在這一領(lǐng)域的探索。他參加ISSCC會(huì)議,也是來講Loihi的。

Loihi用了一種名叫尖峰神經(jīng)元(spiking neurons)的技術(shù),這類神經(jīng)元只有在輸入樣本后才能被激活。

神經(jīng)形態(tài)計(jì)算倡導(dǎo)者們認(rèn)為,這種方法更好地模擬了大腦的運(yùn)行機(jī)制,比如說信號(hào)傳遞的過程就像大腦一樣經(jīng)濟(jì)。

在LeCun看來,神經(jīng)形態(tài)計(jì)算領(lǐng)域沒有產(chǎn)生有實(shí)際效果的算法,為何要為一種沒用的算法構(gòu)建芯片?

不過Davies直接表達(dá)了反對(duì),他說,神經(jīng)形態(tài)計(jì)算產(chǎn)生的算法是有效的,LeCun忽視了神經(jīng)形態(tài)計(jì)算的優(yōu)勢(shì)。

Davies說:“LeCun反對(duì)尖峰神經(jīng)元,但他卻說我們需要解決硬件中的稀疏性,尖峰神經(jīng)元就是干這個(gè)的啊。”

他說,這太諷刺了。

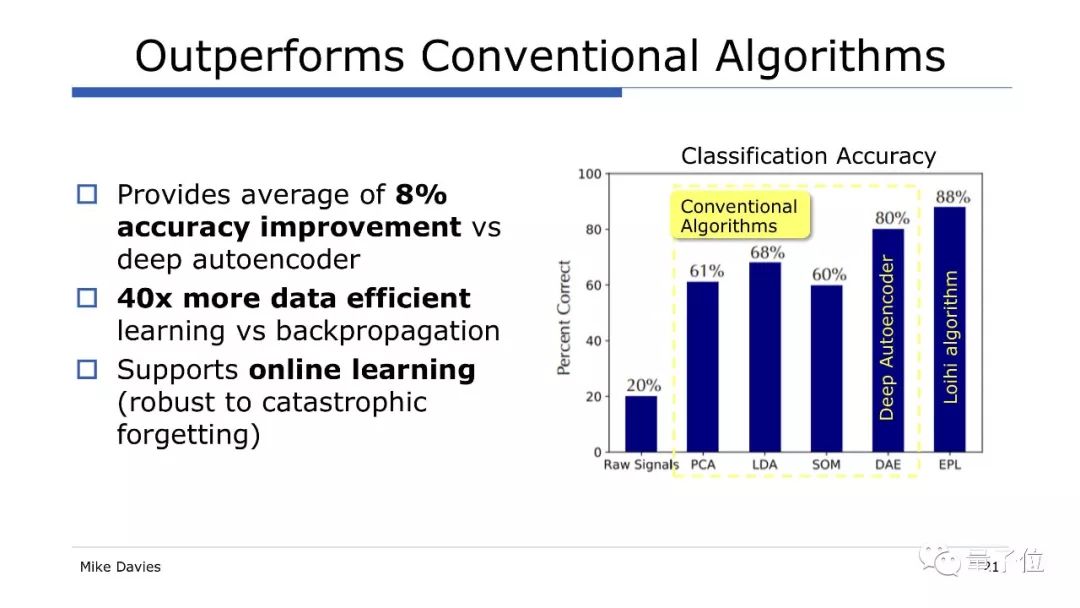

為了駁斥對(duì)尖峰神經(jīng)元的批評(píng),Davies引用了安大略滑鐵盧一個(gè)名叫應(yīng)用腦科學(xué)(Applied Brain Science)的機(jī)構(gòu)的數(shù)據(jù),比較了一種語音檢測(cè)算法在不同芯片上的表現(xiàn)。

這個(gè)算法被要求識(shí)別“aloha”這個(gè)詞,并且拒絕無意義詞語,這家機(jī)構(gòu)在CPU、GPU和Loihi芯片上運(yùn)行了這一算法。

這份數(shù)據(jù)顯示,Loihi在常規(guī)處理器上運(yùn)行常規(guī)神經(jīng)網(wǎng)絡(luò)性能最佳,特別是在計(jì)算速度方面,并且能源效率更高,不過精確度會(huì)低一些。

在另一個(gè)例子中,Davies說Loihi執(zhí)行的基本分類器任務(wù)的速度是傳統(tǒng)的基于GPU的深度學(xué)習(xí)網(wǎng)絡(luò)的40倍,準(zhǔn)確度提高了8%。

因此,Davies認(rèn)為L(zhǎng)oihi效率高得多,可以運(yùn)行規(guī)模越來越大的網(wǎng)絡(luò),他認(rèn)為,機(jī)器人控制將會(huì)是Loihi這類神經(jīng)形態(tài)芯片的殺手級(jí)應(yīng)用。

Davies還從LeCun的批評(píng)挑出了他認(rèn)同的一點(diǎn):尖峰神經(jīng)元的硬件非常充足,提供了很多工具來映射有趣的算法。

針對(duì)這句話后邊隱含的“但是軟件算法層面不行”,Davies說,他的團(tuán)隊(duì)當(dāng)前目標(biāo)就是在算法上取得進(jìn)展,算法確實(shí)拖了這個(gè)領(lǐng)域的后腿。

在推特上,也有人隔空參與了這場(chǎng)辯論。

有人認(rèn)為,神經(jīng)形態(tài)計(jì)算就像量子計(jì)算一樣處在起步階段,所以沒什么可批判的。

也有人覺得深度學(xué)習(xí)已經(jīng)在許多領(lǐng)域內(nèi)取得了成果,量子計(jì)算和神經(jīng)形態(tài)計(jì)算還差得遠(yuǎn),雖然技術(shù)很尤其,但兩者都沒有被證實(shí),而且都沒有編程模型。

其實(shí),這場(chǎng)LeCun和Davies的爭(zhēng)斗,除了學(xué)術(shù)方面之外,另外不得不考慮的一點(diǎn)就是Facebook和英特爾的商業(yè)競(jìng)爭(zhēng)。

周一,LeCun表示Facebook內(nèi)部正在開發(fā)AI芯片,一旦Facebook自己的芯片研發(fā)成功,那就不需要使用英特爾的芯片了,甚至還會(huì)搶走英特爾的客戶。

看完這場(chǎng)隔空口水戰(zhàn)的來龍去脈,我們把目光收回到Davies指責(zé)的核心:反向傳播。

訓(xùn)練深度學(xué)習(xí)模型離不開它,但對(duì)它的質(zhì)疑也接連不斷。

反向傳播到底行不行?

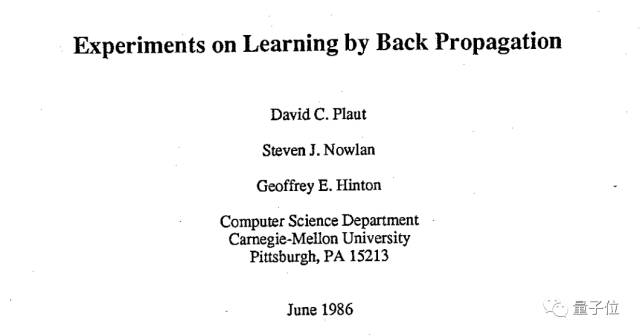

反向傳播,生于1986,出自David Plaut、Steven Nowlan、Geoffrey Hinton在卡耐基梅隆大學(xué)(CMU)時(shí)發(fā)表的Nature論文:Experiments on Learning by Back Propagation。

△www.cs.toronto.edu/~fritz/absps/bptr.pdf

31年后,這一概念已經(jīng)隨著深度學(xué)習(xí)廣泛應(yīng)用到了各種領(lǐng)域,也遇到了最大的一次危機(jī)。

它的的提出者之一、“深度學(xué)習(xí)之父”Hinton在多倫多舉辦的一場(chǎng)會(huì)議上公開提出了質(zhì)疑。

他說,他對(duì)反向傳播“深感懷疑”,甚至想“全部拋掉,重頭再來”。因?yàn)椋竽X的運(yùn)作機(jī)制并不是這樣的。

“不像大腦”這個(gè)問題,Hinton一直非常重視,他曾在MIT的一次講座上說,他相信正是這些不像大腦的東西,導(dǎo)致人工神經(jīng)網(wǎng)絡(luò)的效果不夠好。

在Hinton發(fā)出自我質(zhì)疑之后,反向傳播更成了討論的熱點(diǎn),甚至被稱為“今日AI的阿喀琉斯之踵”。

不過現(xiàn)在,可能Hinton應(yīng)該自己的作品稍微滿意一點(diǎn)了。

哈佛大學(xué)臨床神經(jīng)科學(xué)學(xué)院的兩位科學(xué)家在最新一期Cell旗下期刊《認(rèn)知科學(xué)趨勢(shì)》(Trends in Cognitive Sciences)上發(fā)表綜述,總結(jié)了人工神經(jīng)網(wǎng)絡(luò)的反向傳播算法,在大腦中是怎樣體現(xiàn)的。

這篇綜述題為“大腦中誤差反向傳播的理論”(Theories of Error Back-Propagation in the Brain),綜合了近來的一批理論研究,分析幾類生物反向傳播模型。

作者說,這些理論研究“否定了過去30年來普遍接受的教條,即:誤差反向傳播算法太復(fù)雜,大腦無法實(shí)現(xiàn)”。

根據(jù)這些研究,腦神經(jīng)回路中類似反向傳播的機(jī)制,是基于突觸前和突觸后神經(jīng)元活動(dòng)的簡(jiǎn)單突觸可塑性規(guī)則。

論文:https://www.cell.com/trends/cognitive-sciences/fulltext/S1364-6613(19)30012-9